كيفية بناء نموذج لغوي كبير (LLM) من الصفر وماذا يعلمك ذلك

خلاصة القول يستغرق بناء نموذج لغوي بسيط من الصفر أقل من 300 سطر من بايثون. تكشف العملية بالضبط كيف تعمل عملية ترميز النص (tokenization)، والانتباه (attention)، والاستدلال (inference)، مما يجعلك مست...

Source: DEV Community

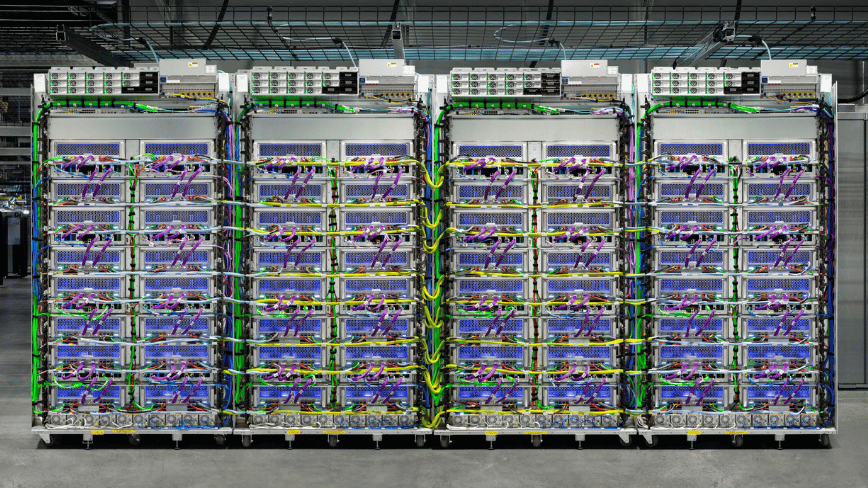

خلاصة القول يستغرق بناء نموذج لغوي بسيط من الصفر أقل من 300 سطر من بايثون. تكشف العملية بالضبط كيف تعمل عملية ترميز النص (tokenization)، والانتباه (attention)، والاستدلال (inference)، مما يجعلك مستهلكًا أفضل بكثير لواجهات برمجة التطبيقات (API) عند دمج نماذج اللغة الكبيرة (LLMs) في تطبيقاتك. جرّب Apidog اليوم مقدمة يتعامل معظم المطورين مع النماذج اللغوية كصناديق سوداء. ترسل نصًا إليها، وتخرج رموزًا (tokens)، وبين هذا وذاك، يحدث السحر. يعمل هذا النموذج الذهني بشكل جيد حتى تحتاج إلى تصحيح خطأ في دمج واجهة برمجة تطبيقات معطلة، أو ضبط معلمات أخذ العينات، أو معرفة سبب استمرار نموذجك في هلوسة البيانات المهيكلة. مشروع GuppyLM، الذي تصدر مؤخرًا الصفحة الرئيسية لموقع HackerNews بـ 842 نقطة، يجعل التفاصيل الداخلية مرئية. إنه محول (transformer) يحتوي على 8.7 مليون معلمة مكتوب من الصفر بلغة بايثون. يتدرب في أقل من ساعة على وحدة معالجة رسوميات استهلاكية (GPU). الرمز البرمجي يتناسب مع ملف واحد. الهدف ليس التنافس مع GPT-4؛ بل هو إزالة الغموض عن كيفية عمل نماذج اللغة الكبيرة (LLMs) بالفعل. تتناول هذه ا